Das EU-KI-Gesetz ist offiziell in Kraft getreten und markiert den Beginn einer verbindlichen KI-Regulierung in Europa. Als weltweit erster umfassender Rechtsrahmen für künstliche Intelligenz legt er strenge Regeln fest, die gewährleisten sollen, dass KI sicher, transparent und rechenschaftspflichtig ist. Die Fristen für die Einhaltung der Vorschriften sind bereits in Sicht, und Unternehmen, die in der EU tätig sind, müssen jetzt handeln, um sich vorzubereiten.

Für Unternehmen, die sich auf Microsoft 365, Copilot und die Power Platform verlassen, ist dies besonders dringend. Diese Tools werden zu einem zentralen Bestandteil der täglichen Arbeit, stellen aber auch eine Herausforderung für die Einhaltung von Vorschriften dar: Was passiert, wenn Copilot Einstellungsentscheidungen unterstützt? Wie regeln Sie KI-gestützte Workflows in Power Automate? Und wie können Sie Compliance nachweisen, wenn die Aufsichtsbehörden anklopfen?

Dieser Leitfaden erklärt , was das EU-KI-Gesetz für Ihre Microsoft-Umgebung bedeutet. Wir werden den risikobasierten Rahmen des Gesetzes aufschlüsseln, die wichtigsten Compliance-Verpflichtungen hervorheben und zeigen, wie Sie Risiken in Microsoft 365 und Copilot verwalten können, ohne die Innovation zu bremsen.

Zusammenfassung des EU-KI-Gesetzes: Ein kurzer Überblick

Das EU-KI-Gesetz trat am 1. August 2024 in Kraft, nachdem es im Juli im Amtsblatt der Europäischen Union veröffentlicht wurde. Sie ist der weltweit erste umfassende, verbindliche Rechtsrahmen für künstliche Intelligenz und ein Eckpfeiler der digitalen Strategie der EU. Er soll sicherstellen, dass die in Europa eingesetzten KI-Systeme sicher, transparent, nachvollziehbar, nicht diskriminierend und unter menschlicher Aufsicht sind.

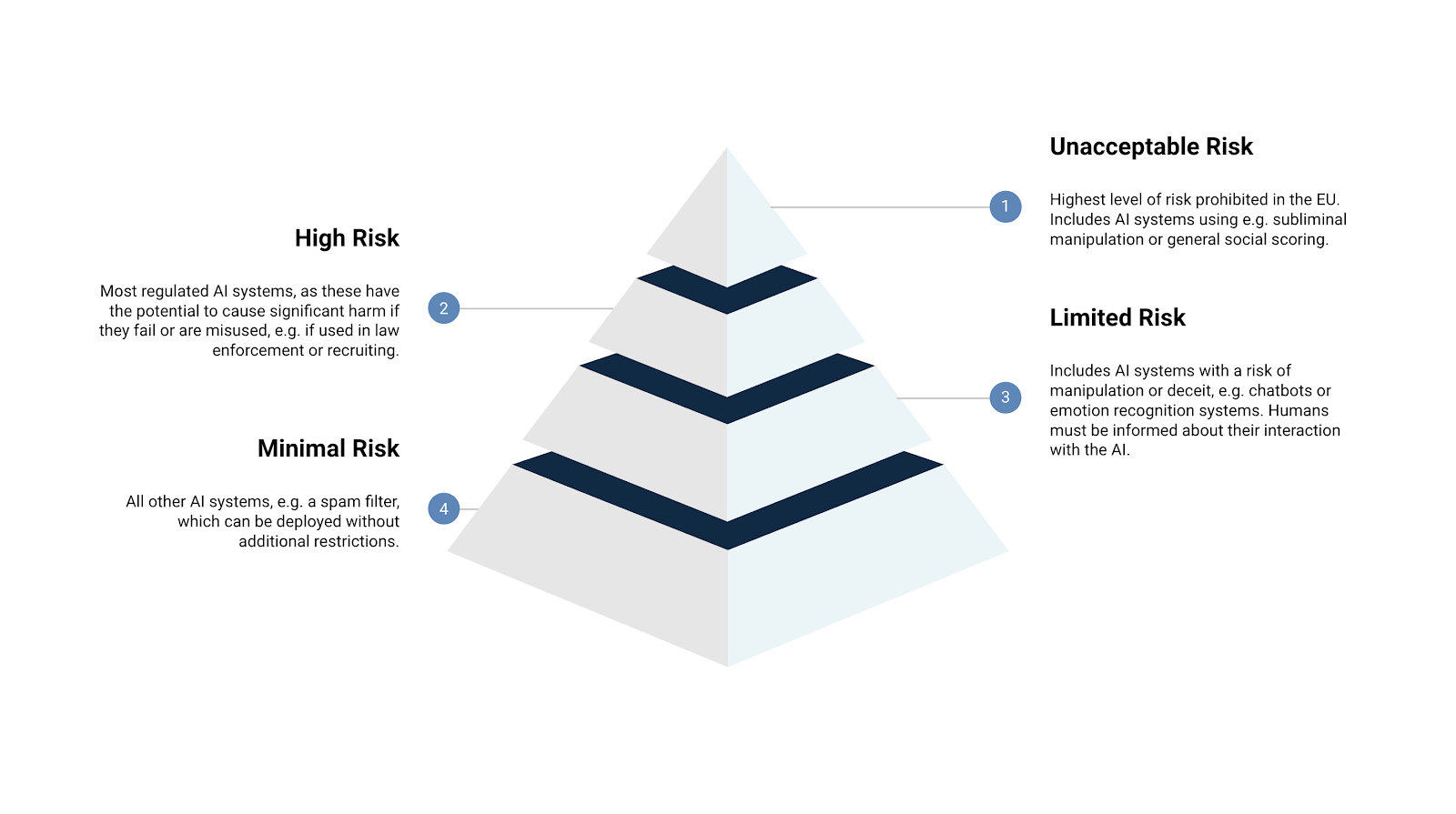

Im Gegensatz zu einem Einheitsgesetz wendet das EU-KI-Gesetz ein risikobasiertes Modell an. Je stärker die potenziellen Auswirkungen eines KI-Systems auf die Gesellschaft, die Gesundheit, die Sicherheit oder die Grundrechte sind, desto strenger sind die rechtlichen Anforderungen.

Anwendungsbereich und Zweck: Was regelt das EU-KI-Gesetz?

Das Gesetz über künstliche Intelligenz der Europäischen Union legt Regeln für die sektorübergreifende Regulierung von KI fest. Hauptziel des Gesetzes ist es, das Vertrauen in KI zu fördern und die Einführung von Innovationen, die den Menschen in den Mittelpunkt stellen, voranzutreiben und gleichzeitig die Risiken zu verringern. Es gilt für die gesamte KI-Wertschöpfungskette, sowohl für die Anbieter als auch für die Nutzer.

Für wen gilt das Gesetz?

- Anbieter: Unternehmen, die ein KI-System entwickeln und es auf den Markt bringen (z. B. Microsoft).

- Einsatzbetriebe: Organisationen, die ein KI-System professionell nutzen (das sind die meisten unserer Kunden und wahrscheinlich auch Sie).

- Importeure/Vertriebspartner: Unternehmen, die KI-Systeme auf den EU-Markt bringen.

Wenn Ihr Unternehmen KI-Tools im Dienste von Kunden oder für interne Prozesse innerhalb der EU einsetzt, gilt das KI-Gesetz für Sie.

Risikoklassifizierung des EU-KI-Gesetzes: Wie werden KI-Systeme kategorisiert?

In der Verordnung werden KI-Systeme in vier verschiedene Risikokategorien eingeteilt. Zu verstehen, in welche Kategorie Ihre KI-Anwendungsfälle fallen, ist der erste Schritt zur Einhaltung der Vorschriften.

Quelle: https://www.trail-ml.com/blog/eu-ai-act-how-risk-is-classified

Quelle: https://www.trail-ml.com/blog/eu-ai-act-how-risk-is-classified

❌ Unannehmbares Risiko (verboten)

Dies sind KI-Systeme, die eine eindeutige Bedrohung für die Sicherheit und die Grundrechte der Menschen darstellen.

Beispiele hierfür sind:

- Soziales Scoring durch Regierungen

- Biometrische Fernidentifizierung in Echtzeit im öffentlichen Raum (mit engen Ausnahmen für die Strafverfolgung)

- Manipulative KI, die Schwachstellen ausnutzt.

Das KI-Gesetz verbietet diese Systeme in Europa seit Februar 2025.

⚠️ Hochriskante KI (streng reguliert)

Dies ist die kritischste Kategorie für Unternehmen. Hochriskante Systeme umfassen KI, die in physischen oder virtuellen Umgebungen eingesetzt wird, in denen Sicherheit, Rechte oder Compliance beeinträchtigt werden könnten. Sie können auch ein systemisches Risiko darstellen, wenn sie in großem Umfang eingesetzt werden. Diese Systeme sind nicht verboten, unterliegen aber strengen Auflagen, bevor sie auf den Markt gebracht werden können und während ihres gesamten Lebenszyklus.

Beispiele hierfür sind:

- KI bei der Personalbeschaffung (Sortierung von Lebensläufen, Analyse von Vorstellungsgesprächen)

- KI für die Kreditwürdigkeitsprüfung und die Bewertung der Kreditwürdigkeit

- KI in kritischen Infrastrukturen (z. B. Wasser- oder Energieversorgungsmanagement)

- KI-Komponenten in medizinischen Geräten oder Fahrzeugen

- KI bei der Strafverfolgung und im Justizwesen

ℹ️ KI mit begrenztem Risiko (Transparenzverpflichtungen)

Zu dieser Kategorie gehören KI-Systeme, die mit Menschen interagieren. Die wichtigste Anforderung ist die Transparenz. Die Nutzer müssen eindeutig darüber informiert werden, dass sie mit einem KI-System interagieren oder dass der Inhalt von KI generiert wurde. Microsoft Copilot würde in vielen seiner Standardanwendungsfälle wahrscheinlich in diese Kategorie fallen.

Beispiele hierfür sind:

- Chatbots für den Kundensupport

- KI-generierte Inhalte (z. B. Deepfakes mit Offenlegung)

- Microsoft Copilot bei alltäglichen Produktivitätsaufgaben

✅ Minimale oder risikofreie KI (keine Regulierung)

Es wird erwartet, dass die große Mehrheit der KI-Systeme unter diese Kategorie fällt. Das KI-Gesetz erlegt diesen Systemen keine rechtlichen Verpflichtungen auf, allerdings können sich die Anbieter an freiwillige Verhaltenskodizes halten.

Beispiele hierfür sind:

- KI-gestützte Videospiele

- Spam-Filter

- Systeme zur Bestandsverwaltung

Was sind die wichtigsten Compliance-Verpflichtungen?

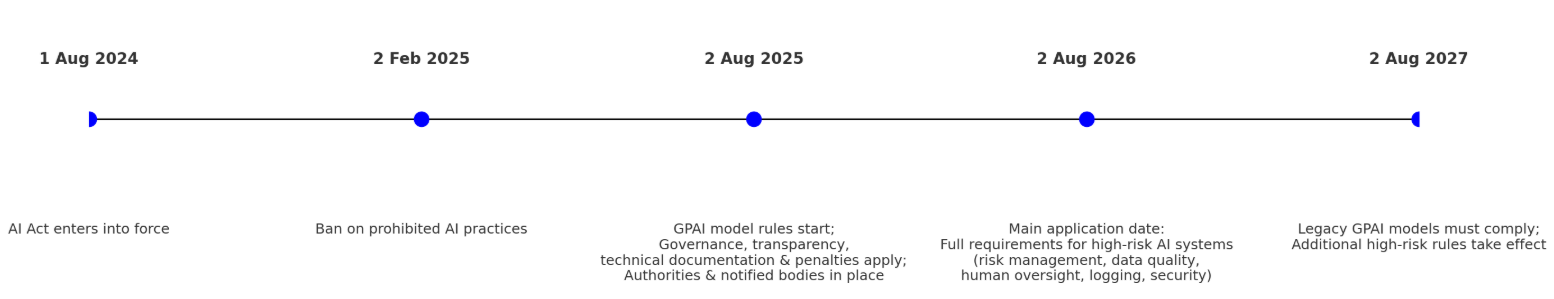

Das EU-KI-Gesetz trat am 1. August 2024 in Kraft, aber seine Verpflichtungen gelten nicht auf einmal. Stattdessen werden sie über mehrere Jahre hinweg schrittweise eingeführt, wobei die wichtigsten Fristen in den Jahren 2025, 2026 und 2027 liegen. Diese stufenweise Einführung bedeutet, dass Unternehmen sich im Voraus vorbereiten müssen: Einige Regeln sind bereits verbindlich (wie das Verbot verbotener KI-Praktiken im Februar 2025), während die anspruchsvollsten Anforderungen für KI-Systeme mit hohem Risiko ab August 2026 gelten. Die nachstehende Roadmap zeigt die entscheidenden Meilensteine, die Sie im Auge behalten müssen.

Zeitplan: Zeitplan für die Durchsetzung des EU-KI-Gesetzes (2024-2027)

2024

- 1. August 2024: Die Verordnung tritt in Kraft.

2025

- 2. Februar 2025: Erste Verpflichtungen treten in Kraft: Verbote von verbotenen KI-Praktiken (z.B. Social Scoring, manipulative KI) und Schlüsseldefinitionen treten in Kraft.

- 10. Juli 2025: Das Europäische Amt für KI veröffentlicht den endgültigen General-Purpose AI (GPAI) Code of Practice. Der Kodex ist zwar freiwillig, bietet aber praktische Anleitungen für Anbieter und kann bis zur Verabschiedung harmonisierter EU-Standards als Compliance-Instrument dienen.

- 2. August 2025: Die Verpflichtungen beginnen zu gelten:

- Die Verpflichtungen beginnen für KI-Modelle für allgemeine Zwecke, die ab diesem Datum auf den Markt gebracht werden.

- Die Anforderungen an Governance, Transparenz, technische Dokumentation und Vertraulichkeit beginnen.

- Benannte Stellen müssen funktionsfähig sein und zuständige Behörden benannt werden.

- Sanktions-/Bußgeldregelungen gemäß den Artikeln 99-100 müssen vorhanden sein und notifiziert werden.

2026

- 2. August 2026: Das Hauptanwendungsdatum. Die meisten übrigen Bestimmungen gelten, einschließlich der strengen Verpflichtungen für KI-Systeme mit hohem Risiko:

- Kontinuierliches Risikomanagement und technische Dokumentation

- Datenmanagement und Qualitätsanforderungen

- Mechanismen für die menschliche Aufsicht

- Protokollierung, Transparenz und Erklärbarkeit

- Genauigkeit, Robustheit und Cybersicherheitsvorkehrungen

2027

- 2. August 2027: Die Übergangsfrist endet für alte GPAI-Modelle, die vor dem 2. August 2025 auf den Markt gebracht wurden. Ab diesem Datum müssen alle GPAI-Modelle den Anforderungen entsprechen. Außerdem treten die Verpflichtungen nach Artikel 6 Absatz 1 (Einstufung von in regulierte Produkte eingebetteten Hochrisikosystemen) und andere Altlasten in vollem Umfang in Kraft.

Was dies für Microsoft 365 und Copilot bedeutet

Für Microsoft 365-, Copilot- und Power Platform-Umgebungen sind zwei Meilensteine von Bedeutung:

- Ab August 2025 sind Durchsetzungsstrukturen vorhanden, und die GPAI-Verpflichtungen betreffen Copilot selbst.

- Ab August 2026 müssen Unternehmen, die Copilot in risikoreichen Arbeitsabläufen einsetzen, die vollständigen Compliance-Anforderungen des Gesetzes erfüllen.

Um sich auf diese Fristen vorzubereiten, sollten Unternehmen, die Microsoft 365, Copilot und die Power Platform nutzen, sich auf die folgenden Compliance-Prioritäten konzentrieren:

- Strenges Risikomanagement und Dokumentation: Sie müssen ein kontinuierliches Risikomanagement-System während des gesamten Lebenszyklus des KI-Systems einrichten. Dazu gehören die Identifizierung, Analyse und Abschwächung von Risiken. Es muss eine detaillierte technische Dokumentation geführt werden, um die Einhaltung der Vorschriften nachzuweisen.

- Datenverwaltung und -qualität: Systeme mit hohem Risiko müssen auf hochwertigen, relevanten und repräsentativen Datensätzen trainiert werden, um das Risiko von Verzerrungen und Diskriminierung zu minimieren.

- Menschliche Aufsicht: Die Systeme müssen so konzipiert sein, dass eine wirksame menschliche Kontrolle möglich ist. Das bedeutet, dass Menschen in der Lage sein müssen, die Fähigkeiten und Grenzen des Systems zu verstehen, seinen Betrieb zu überwachen und die Möglichkeit zu haben, einzugreifen oder es bei Bedarf außer Kraft zu setzen.

- Protokollierung und Nachvollziehbarkeit: KI-Systeme mit hohem Risiko müssen automatisch Ereignisse (Protokolle) aufzeichnen, während sie in Betrieb sind. Dadurch wird ein gewisses Maß an Rückverfolgbarkeit für Untersuchungen und Audits nach einem Vorfall gewährleistet.

- Transparenz und Erklärbarkeit: Die Betreiber müssen ihren Benutzern klare Anweisungen für die Nutzung geben. Es sollte nachvollziehbar sein, wie das KI-System zu einem bestimmten Ergebnis gekommen ist, insbesondere bei Entscheidungen, die erhebliche Auswirkungen auf Menschen haben.

- Genauigkeit, Robustheit und Cybersicherheit: Die Systeme müssen konsistent funktionieren und widerstandsfähig gegen Fehler oder Versuche sein, ihre Nutzung oder Leistung zu verändern.

Warum Microsoft-Umgebungen besondere Aufmerksamkeit verdienen

Die abstrakten Prinzipien des KI-Gesetzes werden sehr real, wenn sie auf die Tools angewendet werden, die Ihr Unternehmen täglich nutzt. Das Microsoft-Ökosystem (einschließlich Microsoft 365, Power Platform und Copilot) ist ein leistungsstarker Motor für die Produktivität, aber es ist auch eine komplexe Umgebung, in der KI in einem noch nie dagewesenen Umfang eingesetzt wird.

Data Governance allein ist nicht genug

Die meisten Unternehmen betrachten die Einhaltung von Vorschriften durch die Brille der Data Governance: Klassifizierung und Schutz sensibler Inhalte mit Tools wie Microsoft Purview. Dieser Schutz auf Datenebene ist zwar unerlässlich, reicht aber nicht aus, um die Erstellung, Bereitstellung und Verwaltung von KI-Systemen zu gewährleisten. Das KI-Gesetz erfordert auch eine Verantwortlichkeit auf Dienstebene für Teams, SharePoint-Sites, Power Automate-Flows und Copilot-Agenten.

Wenn begrenztes Risiko zu hohem Risiko wird

Microsoft Copilot ist oft ein KI-System mit begrenztem Risiko. Es kann jedoch leicht Teil eines risikoreichen Workflows werden. Wenn ein Manager Copilot verwendet wird, um Leistungsbeurteilungen zusammenzufassen, um Beförderungsentscheidungen zu treffen, könnte dieser gesamte Prozess als risikoreich eingestuft werden. Ähnlich verhält es sich mit einem Power Automate Workflow, der AI Builder zur Prüfung von Bewerbungen einsetzt und somit in die Hochrisikokategorie fällt.

An diesem Punkt hängt die Compliance nicht nur von der Datensicherheit ab, sondern auch davon, ob Sie über Service-Governance-Strukturen zur Kontrolle der Dienste, Agenten und Automatisierungen verfügen, die diese Workflows steuern.

KI-Governance als Service-Governance

An dieser Stelle wird KI-Governance untrennbar mit Service-Governance verbunden. Nicht verwaltete Copilot Studio-Agenten, verwaiste Power Automate-Abläufe oder von Geschäftsanwendern erstellte KI-Schattenanwendungen können zu Compliance-Risiken im Rahmen des KI-Gesetzes führen. Ohne zentralisierte Sichtbarkeit und Lebenszykluskontrolle fallen diese Ressourcen durch die Maschen und untergraben sowohl die Compliance als auch die Sicherheit.

Hauptrisiken für Microsoft 365- und Copilot-Umgebungen

Um zu verstehen, warum Service Governance so wichtig ist, ist es hilfreich, sich die konkreten Risiken anzusehen, denen Unternehmen beim Einsatz von KI in Microsoft 365 ausgesetzt sind.

Schatten-KI und Wildwuchs

Die Benutzerfreundlichkeit von Tools wie Power Platform und Copilot Studio gibt Geschäftsanwendern die Möglichkeit, ihre eigenen KI-gestützten Lösungen zu erstellen. Ohne zentrale Sichtbarkeit können "Schatten-KI-Agenten" und nicht verwaltete Anwendungen sich ausbreiten und unbekannte Compliance- und Sicherheitsrisiken schaffen.

Fehlinformationen durch unzuverlässige Inhalte

Copilot bezieht Informationen aus Ihrem gesamten M365-Mieter. Wenn Ihre Umgebung mit veralteten Dokumenten, doppelten Dateien und widersprüchlichen Informationen überladen ist (ein Zustand, den wir als "Informationschaos" bezeichnen), kann Copilot ungenaue oder irreführende Zusammenfassungen erstellen. Dies führt zu schlechten Geschäftsentscheidungen und potenziellen Fehlinformationen.

Schwache Datenverwaltung und Zugriffskontrollen

Damit KI sicher arbeiten kann, müssen die zugrunde liegenden Daten ordnungsgemäß gesichert sein. An wen kann Copilot sensible Dokumente weitergeben? Wie verhindern Sie unbefugten Zugriff? Schwache Zugriffskontrollen oder eine schlechte Informationsarchitektur können zu Datenlecks, Verstößen gegen die Datenschutz-Grundverordnung (DSGVO) und Verstößen gegen das KI-Gesetz führen. Die Einhaltung der Vorschriften erfordert einen vielschichtigen Ansatz, der oft Tools wie Microsoft Purview und eine robuste Governance-Plattform umfasst.

Fehlendes Lebenszyklus-Management

Die Einhaltung von Vorschriften hängt auch von der Verwaltung von Diensten und Arbeitsabläufen ab. Ohne Regeln für Eigentümerschaft, Bereitstellung und Stilllegung riskieren Unternehmen verwaiste Anwendungen, übermäßig exponierte Berechtigungen und nicht verwaltete KI-Agenten. Diese Probleme untergraben direkt die Einhaltung des KI-Gesetzes.

Checkliste zur Einhaltung des EU AI Act:

7 Schritte zur Vorbereitung

Der Umgang mit der neuen KI-Verordnung in Europa erfordert einen proaktiven, strukturierten Ansatz. Es geht darum, einen nachhaltigen Governance-Rahmen aufzubauen, der eine sichere und effektive KI-Einführung ermöglicht. Hier finden Sie einen klaren Fahrplan für die Einhaltung des EU-KI-Gesetzes in Microsoft 365-Umgebungen.

1. Inventarisieren und klassifizieren Sie Ihre KI-Systeme

Ihr erster Schritt besteht darin, vollständige Transparenz zu erreichen. Sie benötigen ein umfassendes Inventar aller KI-Systeme und KI-gestützten Workflows in Ihrem Unternehmen, insbesondere in Ihren Microsoft 365- und Power Platform-Tenants.

- Was ist zu tun? Identifizieren Sie alle Anwendungen, Workflows und Agenten, die KI nutzen. Dazu gehören kommerzielle Standard-Tools wie Copilot, kundenspezifische Lösungen auf Power Platform und Integrationen von Drittanbietern.

- Wie Rencore hilft: Als umfassende Governance-Lösung bietet Rencore eine 360°-Bestandsaufnahme über Ihre gesamte Microsoft-Cloud. Wir erkennen und katalogisieren automatisch jede Ressource, von Power Apps und Automate-Flows bis hin zu Copilot-Agenten, und verschaffen Ihnen so die nötige Transparenz, um mit der Klassifizierung zu beginnen.

2. Bewertung risikoreicher Workflows

Sobald Sie über ein Inventar verfügen, müssen Sie das Risiko jedes KI-Anwendungsfalls anhand der Kriterien des KI-Gesetzes bewerten. Dabei geht es nicht um die Technologie selbst, sondern darum, wie sie eingesetzt wird.

- Was ist zu tun? Analysieren Sie den geschäftlichen Kontext für jedes KI-System. Wird es für die Personalbeschaffung eingesetzt? Finanzielle Entscheidungsfindung? Kundenservice? Dokumentieren Sie dieses Mapping sorgfältig. Ein einfacher Chatbot in Ihrem Intranet stellt ein minimales Risiko dar, aber dieselbe Technologie, die zur Vorauswahl von Kreditanträgen verwendet wird, ist hochriskant.

- Wie Rencore hilft: Mit einer vollständigen Bestandsaufnahme können Sie Anwendungen auf der Grundlage ihres Geschäftszwecks und ihrer Risikostufe kennzeichnen und kategorisieren. So können Sie Ihre Governance-Bemühungen dort konzentrieren, wo sie am dringendsten benötigt werden, nämlich auf die Hochrisikosysteme, die eine strenge Überwachung erfordern.

3. Definieren und Durchsetzen von KI-Governance-Richtlinien

Klare Regeln sind für die sichere Einführung von KI unerlässlich. Ihr Unternehmen benötigt eine formale KI-Governance-Richtlinie, die die zulässige Nutzung, die Standards für die Datenverarbeitung, die Transparenzanforderungen und den Prozess zur Überprüfung und Genehmigung neuer KI-Lösungen festlegt.

- Was ist zu tun? Erstellen Sie Richtlinien, die sich an den Anforderungen des KI-Gesetzes für Hochrisikosysteme orientieren (z. B. die Vorschrift, dass alle KI-gesteuerten Personalentscheidungen von Menschen überprüft werden müssen). Kommunizieren Sie diese Richtlinien klar und deutlich innerhalb des Unternehmens.

- Wie Rencore hilft: Rencore Governance ermöglicht es Ihnen, Ihre Richtlinien in automatisierte Regeln zu übersetzen. Sie können Richtlinien erstellen, um nicht autorisierte KI-Agenten zu erkennen, Power Apps zu kennzeichnen, die sensible Datenkonnektoren verwenden, oder automatisch Zugriffsüberprüfungen für Arbeitsbereiche mit hohem Risiko auszulösen.

4. Automatisieren Sie die Überwachung und Dokumentation

Compliance ist ein fortlaufender Prozess. Das EU-KI-Gesetz verlangt eine kontinuierliche Überwachung und detaillierte Protokollierung für Hochrisikosysteme. Manuelle Kontrollen sind einfach nicht skalierbar oder zuverlässig genug.

- Was zu tun ist: Implementieren Sie Systeme zur kontinuierlichen Überwachung Ihrer KI-Landschaft auf Richtlinienverstöße, verfolgen Sie die Nutzung und führen Sie detaillierte Prüfprotokolle über alle Aktivitäten.

- Wie Rencore hilft: Unsere Plattform bietet eine kontinuierliche KI-Überwachung und einen vollständigen Audit-Trail. Wir protokollieren alle App- und Service-Aktivitäten, Zugriffsänderungen und Lebenszyklusereignisse. Unsere anpassbaren Dashboards geben Ihnen Einblicke in Echtzeit, und automatische Überprüfungen von Verstößen stellen sicher, dass Sie immer über aufkommende Risiken informiert sind.

5. Verwalten Sie den Lebenszyklus von KI-Ressourcen

Unkontrollierte Ausbreitung schafft Risiken. Verwaiste Teams, Abläufe oder Copilot-Agenten können noch lange nach ihrem Einsatz aktiv bleiben, wodurch sensible Daten offengelegt und die Compliance verletzt werden.

- Was ist zu tun? Legen Sie Lebenszyklus-Richtlinien fest: Archivieren Sie inaktive Teams und SharePoint-Sites, deaktivieren Sie verwaiste AI-Agenten und verlangen Sie erneute Eigentümerbestätigungen.

- Wie Rencore hilft: Rencore automatisiert das Lebenszyklus-Management indem es ungenutzte Ressourcen erkennt und Bereinigungsaktionen oder Eigentümerbestätigungen auslöst.

6. Sicherstellung von Kostentransparenz und -optimierung

Die Einführung von KI treibt auch die Kosten in die Höhe, von Copilot-Lizenzen bis zum Speicherverbrauch. Ohne Transparenz können die Budgets in die Höhe schnellen, und nicht verwaltete Dienste erhöhen das Compliance-Risiko.

- Was ist zu tun? Verfolgen Sie KI-bezogene Kosten und verknüpfen Sie sie mit den Eigentumsverhältnissen und Aktivitäten. Optimieren Sie Lizenzen und Speicherplatz auf Basis der tatsächlichen Nutzung.

- Wie Rencore hilft: Rencore verknüpft Kosten (Speicher, Lizenzen, Copilot-Nutzung) mit Eigentümern und Aktivitäten und ermöglicht so Kostenkontrolle und Compliance-Reporting an einem Ort.

7. Bleiben Sie revisionssicher mit einer zentralisierten Governance-Plattform

Wenn Aufsichtsbehörden oder Wirtschaftsprüfer bei Ihnen anklopfen, müssen Sie in der Lage sein, die Einhaltung der Vorschriften schnell und sicher nachzuweisen. Das bedeutet, dass Sie Ihre gesamte Dokumentation, Risikobewertungen, Richtlinien und Prüfungsprotokolle an einem zentralen Ort zur Verfügung haben.

- Was zu tun ist: Konsolidieren Sie Ihre Governance-Bemühungen in einer einzigen Quelle der Wahrheit. Dies verhindert eine fragmentierte Überwachung und stellt sicher, dass Ihre Konformität konsistent und leicht nachweisbar ist.

- Wie Rencore hilft: Rencore Governance fungiert als Ihre zentrale Kommandozentrale für Microsoft Cloud Governance. Von der Inventarisierung und Risikoklassifizierung bis hin zur Durchsetzung von Richtlinien und Prüfprotokollen bietet unsere Plattform die End-to-End-Funktionen, die Sie benötigen, um den EU AI Act zu erfüllen und stets auditfähig zu bleiben.

Über den AU AI Act hinaus: Andere europäische KI-Gesetze und Verordnungen

Das EU-KI-Gesetz ist ein Meilenstein, aber es ist nicht die einzige Vorschrift in der Europäischen Union, die bestimmt, wie KI in Microsoft-Umgebungen verantwortungsvoll eingesetzt werden muss. Hier sind die wichtigsten, die Sie auf dem Radar behalten sollten:

DSGVO (Deutsche Datenschutz-Grundverordnung)

Die DSGVO ist der zentrale Rahmen der EU für den Schutz personenbezogener Daten.

- Warum das wichtig ist: KI-Systeme wie Copilot verarbeiten häufig personenbezogene Daten, wenn sie E-Mails, Dokumente oder Chats zusammenfassen. Die DSGVO regelt nach wie vor, wie diese Daten erfasst, gespeichert und geschützt werden müssen.

- Kurzer Tipp für Microsoft 365: Stellen Sie sicher, dass Datenklassifizierung und Zugriffskontrollen vorhanden sind. Copilot sollte nicht in der Lage sein, sensible persönliche Daten an unbefugte Benutzer weiterzugeben. Weitere Details finden Sie in unserem Artikel EU GDPR aus der Sicht von Office 365 verstehen.

Gesetz über digitale Dienste (DSA)

Der DSA regelt die Transparenz und Rechenschaftspflicht für algorithmische Systeme, insbesondere für große Online-Plattformen.

- Warum das wichtig ist: Er zielt zwar auf Verbraucherplattformen ab, seine Grundsätze gelten aber auch für den Einsatz von KI in Unternehmen.

- Kleiner Tipp für Microsoft 365: Bereiten Sie sich darauf vor, zu erklären, wie die von Copilot generierten Ergebnisse erstellt werden. Die Transparenzverpflichtungen im KI-Gesetz stimmen eng mit den DSA-Grundsätzen überein.

Data Act (DA)

Der Data Act regelt den Zugang zu und die gemeinsame Nutzung von nicht-personenbezogenen Daten, die von vernetzten Geräten und Diensten erzeugt werden.

- Warum das wichtig ist: Für die künstliche Intelligenz bedeutet dies einen fairen Zugang zu hochwertigen Datensätzen.

- Kurzer Tipp für Microsoft 365: Wenn Ihre KI-Workflows auf externe oder IoT-Datenquellen angewiesen sind, stellen Sie sicher, dass die Datenverträge und -integrationen den Anforderungen des Data Act für den Zugang und die gemeinsame Nutzung entsprechen.

KI-Haftungsrichtlinie (vorgeschlagen)

- Warum sie wichtig ist: Sie ergänzt das KI-Gesetz, indem sie es Einzelpersonen oder Unternehmen erleichtert, durch KI-Systeme verursachte Schäden geltend zu machen.

- Kurzer Tipp für Microsoft 365: Dokumentieren Sie Entscheidungsprozesse und den Einsatz von KI (z.B. Copilot in HR oder Finanzen). Eine gute Dokumentation ist nicht nur eine Anforderung des KI-Gesetzes. Sie ist auch Ihre beste Verteidigung, wenn es zu Haftungsansprüchen kommt.

Schlussfolgerung: Nutzen Sie die europäische KI-Verordnung als Chance

Während sich viele Diskussionen über KI-Vorschriften auf der ganzen Welt auf Einschränkungen konzentrieren, sollte das EU-KI-Gesetz als Rahmen für den Aufbau von Vertrauen betrachtet werden. Sie bietet einen klaren Fahrplan für verantwortungsvolle Innovation. Für Unternehmen, die es richtig machen, ist die Einhaltung der Vorschriften mehr als nur eine rechtliche Verpflichtung. Es ist ein Wettbewerbsvorteil, der den Kunden Vertrauenswürdigkeit signalisiert und die Mitarbeiter befähigt, KI vertrauensvoll zu nutzen.

Der Weg zur Compliance beginnt mit Transparenz und Kontrolle. Wenn Sie Ihren KI-Fußabdruck verstehen, Risiken klassifizieren und automatisierte Governance implementieren, können Sie das immense Potenzial von Tools wie Microsoft Copilot und der Power Platform sicher und effektiv nutzen.

Machen Sie Ihr Unternehmen fit für das EU-KI-Gesetz. Entdecken Sie, wie Rencore die KI-Governance in Microsoft 365 und Power Platform vereinfacht und Ihnen hilft, eine zukunftssichere, konforme Governance-Strategie aufzubauen.

Häufig gestellte Fragen (FAQ)

Was ist der EU AI Act?

Das EU-KI-Gesetz ist das weltweit erste umfassende Gesetz zur Regulierung künstlicher Intelligenz. Er verfolgt einen risikobasierten Ansatz und sieht strengere Regeln für KI-Systeme vor, die ein höheres Risiko für die Sicherheit oder die Grundrechte darstellen. Damit soll sichergestellt werden, dass KI sicher, transparent und vertrauenswürdig ist.

Für wen gilt das EU-KI-Gesetz?

Er gilt sowohl für Anbieter, die KI-Systeme entwickeln und auf dem EU-Markt in Verkehr bringen, als auch für Anwender (Organisationen), die KI-Systeme in der EU beruflich nutzen, unabhängig davon, wo der Anbieter oder Anwender seinen Sitz hat.

Was sind hochriskante KI-Systeme?

KI-Systeme mit hohem Risiko werden in sensiblen Bereichen wie Personalbeschaffung, Kreditwürdigkeitsprüfung, kritische Infrastruktur, medizinische Geräte oder Strafverfolgung eingesetzt. Sie müssen strenge Auflagen in Bezug auf Risikomanagement, Dokumentation, Transparenz und menschliche Aufsicht vor dem Einsatz erfüllen.

Wann tritt das EU-KI-Gesetz in Kraft?

Das KI-Gesetz tritt im August 2024 in Kraft. Verbotene Praktiken sind ab Februar 2025 verboten, die GPAI-Verpflichtungen gelten ab August 2025, die meisten Anforderungen für hohe Risiken beginnen im August 2026, und ältere GPAI-Modelle müssen bis August 2027 den Anforderungen entsprechen.

Gilt das EU-KI-Gesetz für Microsoft Copilot?

Ja, abhängig von der Verwendung. Copilot ist in der Regel risikoarm und erfordert Transparenz. Wird Copilot jedoch in Arbeitsabläufe mit hohem Risiko integriert, z. B. bei der Auswahl von Bewerbern oder bei Leistungsprüfungen, wird der gesamte Prozess zu einem hohen Risiko, und Ihr Unternehmen muss strenge Compliance-Verpflichtungen erfüllen.

Wie kann ich mich auf die KI-Regulierung in Europa vorbereiten?

Beginnen Sie mit einer vollständigen Bestandsaufnahme der KI-Systeme, klassifizieren Sie Risiken und dokumentieren Sie risikoreiche Arbeitsabläufe. Implementieren Sie Richtlinien, sorgen Sie für menschliche Aufsicht und automatisieren Sie die Überwachung. Nutzen Sie Governance-Tools wie Rencore, um die Einhaltung der Vorschriften zu zentralisieren, Kosten zu kontrollieren und für Audits gerüstet zu sein.